La generazione automatica di immagini basata su modelli multimodali ha raggiunto un livello di maturità industriale che consente integrazioni dirette in piattaforme di produttività, marketing e ricerca. Il lancio di Nano Banana 2 da parte di Google DeepMind si inserisce in una traiettoria evolutiva iniziata con i primi modelli di sintesi visiva neurale, passata attraverso architetture diffusion-based e consolidata con sistemi multimodali come Gemini.

Il primo modello Nano Banana, reso pubblico ad agosto 2025, aveva già mostrato capacità di editing e creazione visiva ad alta qualità; a novembre 2025 era arrivata la variante Pro, orientata a workflow creativi complessi. Con Nano Banana 2, presentato a febbraio 2026, Google introduce un modello che unisce velocità di inferenza tipica dei modelli Flash a capacità di ragionamento e conoscenza del mondo derivate da Gemini 3.1, con integrazione nativa nei servizi Search, Ads e Cloud.

Architettura del modello e integrazione con Gemini 3.1

Nano Banana 2 è basato sull’infrastruttura Gemini 3.1 Flash Image, una variante ottimizzata per l’inferenza a bassa latenza che sfrutta flussi di generazione visiva paralleli e caching dei prompt intermedi.

Il modello combina componenti di diffusion generativa con un sistema di grounding semantico che attinge a dati aggiornati provenienti dal Web e dall’indice Search di Google. L’uso di una knowledge base in tempo reale consente al sistema di rappresentare correttamente entità specifiche, oggetti riconoscibili e contesti geografici, riducendo errori semantici tipici dei modelli non connessi a fonti aggiornate.

L’integrazione con l’infrastruttura Gemini permette inoltre di utilizzare lo stesso stack multimodale per la generazione di diagrammi, infografiche e visualizzazioni di dati, con un meccanismo avanzato capace di convertire descrizioni testuali in strutture grafiche coerenti.

Il modello utilizza al suo interno un meccanismo di tokenizzazione ibrida, cioè suddivide e codifica sia il testo che le informazioni visive in unità (token), trasformate in embedding, ovvero vettori numerici con una struttura compatibile tra loro, permettendo così di comprendere le istruzioni in modo più accurato.

Qualità visiva, coerenza dei soggetti e controllo creativo

Una delle innovazioni principali riguarda la gestione della subject consistency, ovvero la capacità di mantenere identità e caratteristiche visive costanti tra più immagini o all’interno di sequenze narrative.

Nano Banana 2 può preservare fino a 5 personaggi e mantenere la fedeltà di circa 14 oggetti nello stesso flusso di generazione, caratteristica fondamentale per storyboard, advertising e produzione di contenuti seriali.

Il motore di rendering introduce un miglioramento nella resa delle texture e dell’illuminazione, grazie a un sistema di visual fidelity potenziato che agisce sulle fasi finali della diffusione per aumentare la nitidezza e la profondità cromatica. Il modello supporta output in diverse proporzioni e risoluzioni, da 512 pixel fino a 4K, rendendo possibile la creazione di asset pronti per ambienti social, display pubblicitari e produzioni video.

Un’altra componente chiave è l’aderenza alle istruzioni. Il modulo di instruction following utilizza un sistema di parsing semantico avanzato che scompone prompt complessi in sotto-obiettivi, migliorando la corrispondenza tra richiesta e risultato finale. Questa capacità consente di gestire richieste articolate, come scene multi-personaggio o composizioni con vincoli stilistici specifici.

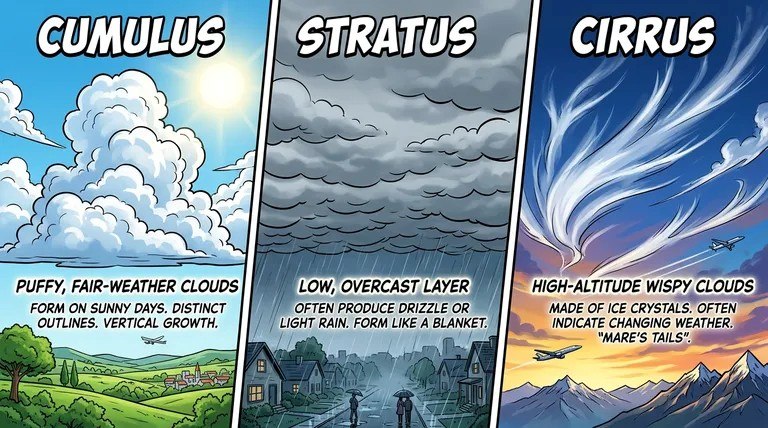

Un’infografica, realizzata da Nano Banana 2, che mette a confronto i vari tipi di nuvole.

Rendering del testo, traduzione e localizzazione nelle immagini

Il rendering tipografico rappresenta storicamente una criticità nei modelli di generazione visiva.

Nano Banana 2 introduce un motore di text rendering che consente di inserire testo leggibile, coerente e semanticamente corretto all’interno delle immagini. Il sistema è in grado di generare mockup per campagne marketing, poster e materiale promozionale con testo accurato, evitando artefatti tipici delle versioni precedenti.

La funzione di localizzazione linguistica permette di tradurre automaticamente il contenuto testuale presente nell’immagine, adattandolo a lingue diverse mantenendo coerenza grafica e contesto culturale. Il meccanismo sfrutta modelli di traduzione neurale integrati nel flusso multimodale, con supporto a più lingue e varianti regionali.

Prestazioni e latenza: l’approccio Flash

L’adozione dell’architettura Flash consente a Nano Banana 2 di operare con tempi di risposta significativamente inferiori rispetto alle versioni Pro.

L’inferenza si avvale di batching dinamico e riduzione dei passaggi di diffusione per accelerare la generazione, mantenendo un equilibrio tra qualità e velocità. Il risultato è una piattaforma adatta a iterazioni rapide, editing continuo e prototipazione visiva in tempo reale.

Le prestazioni sono particolarmente rilevanti in ambienti come Google Ads e strumenti di progettazione integrati, dove la capacità di generare e modificare asset in pochi secondi incide direttamente sulla produttività.

Distribuzione e integrazione nei servizi Google

Nano Banana 2 è distribuito in diversi prodotti della suite Google. Nella Gemini app sostituisce la versione Pro nei modelli Fast, Thinking e Pro, mantenendo comunque la possibilità per gli utenti avanzati di accedere alla versione Pro per attività ad alta fedeltà. Il modello è integrato anche in Search, in modalità AI Mode e Lens, consentendo la generazione e modifica di immagini direttamente dai risultati di ricerca.

Sul versante sviluppo, è disponibile in preview tramite Gemini API e piattaforme come AI Studio e Vertex AI su Google Cloud, permettendo l’integrazione nei flussi di lavoro aziendali e applicativi. L’adozione in strumenti come Flow e nelle piattaforme pubblicitarie Google evidenzia l’obiettivo di rendere la generazione visiva una funzione nativa nei processi digitali.

Come provare subito Nano Banana 2

Per provare Nano Banana 2 si può fare riferimento ad AI Studio e alle Gemini API (prezzi applicati). Su Google Cloud, Nano Banana 2 è disponibile come parte integrante di Vertex AI.

Google ha annunciato l’arrivo del modello anche nell’app Gemini, in Search, all’interno di Flow e Ads.

Provenienza dei contenuti e tracciabilità delle immagini generate

Parallelamente allo sviluppo delle capacità generative, Google ha rafforzato i meccanismi di tracciabilità dei contenuti. Nano Banana 2 utilizza la tecnologia SynthID, che inserisce watermark invisibili nei contenuti generati, combinata con lo standard C2PA Content Credentials per fornire metadati verificabili sulla provenienza delle immagini.

Il sistema consente di identificare non solo l’uso dell’AI nella creazione del contenuto, ma anche il processo utilizzato. La funzionalità di verifica, già integrata nella Gemini app e utilizzata milioni di volte, rappresenta un elemento chiave per contrastare disinformazione e uso improprio dei contenuti sintetici.

Nonostante i progressi, Nano Banana 2 mantiene limiti tipici dei modelli generativi, come la possibilità di interpretazioni errate di prompt ambigui o la difficoltà nel rappresentare scenari altamente specialistici senza dati adeguati. Inoltre, la qualità finale può dipendere dalla precisione delle istruzioni e dalla disponibilità di dati di grounding aggiornati.

/https://www.ilsoftware.it/app/uploads/2026/02/nano-banana-2.jpg)

/https://www.ilsoftware.it/app/uploads/2024/10/copilot-microsoft-nuovi-prompt-pianificati-1.jpg)

/https://www.ilsoftware.it/app/uploads/2026/04/copilot-windows-11-penalizza-firefox.jpg)

/https://www.ilsoftware.it/app/uploads/2026/04/accordo-intel-google-cpu-ipu-ai.jpg)

/https://www.ilsoftware.it/app/uploads/2025/06/gemini-azioni-programmate.jpg)