La possibilità di eseguire modelli linguistici avanzati direttamente su smartphone ha sempre rappresentato una promessa affascinante: meno dipendenza dal cloud, maggiore controllo sui dati, latenza ridotta. Almeno sulla carta. Con il rilascio di Google AI Edge Gallery, app per Android e iOS della quale si è parlato pochissimo, la promessa inizia a prendere forma. Non si tratta di un esperimento accademico: parliamo di un’app disponibile su App Store e Google Play, capace di eseguire LLM (Large Language Models) completamente in locale.

Google ha lavorato per anni sul tema dell’inferenza locale e sull’ottimizzazione di modelli ridotti: basti pensare alla famiglia TensorFlow Lite o ai chip dedicati Tensor nei Pixel. Con AI Edge Gallery, la ricerca si traduce in un prodotto utilizzabile: i modelli della famiglia Gemma, derivati dalle architetture Gemini, sono progettati per funzionare su hardware limitato, con dimensioni contenute e requisiti gestibili da uno smartphone moderno.

Come utilizzare l’AI di Google Gemma in locale, su smartphone

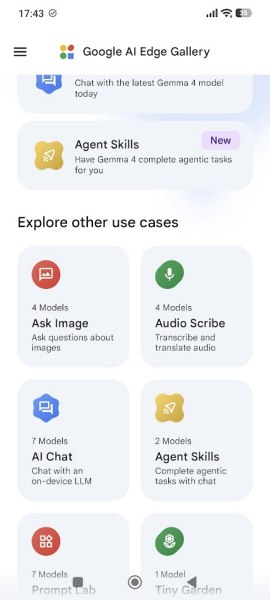

L’avvio dell’applicazione AI Edge Gallery sorprende per semplicità: nessun account obbligatorio, nessuna sincronizzazione iniziale.

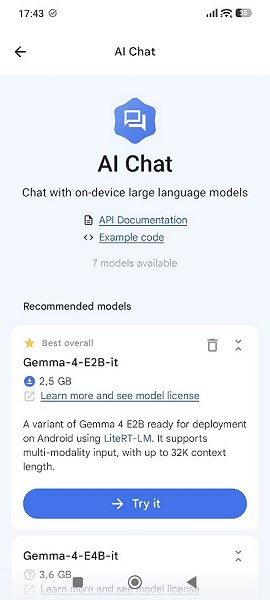

Toccando il riquadro AI Chat, si ha la possibilità di scegliere il modello AI da usare. Il più interessante è Gemma-4-E2B-it, un file da circa 2,5 GB che permette di abilitare attività di inferenza in ambito locale senza scambiare un solo byte con i servizi cloud (ci sono anche modelli più leggeri). Lo si può verificare, ad esempio, attivando la modalità aereo sul telefono.

Dal punto di vista tecnico, il modello offre una finestra di contesto fino a 32K token. È un valore discreto per uso locale, ma distante da soluzioni cloud che arrivano a centinaia di migliaia o milioni di token. In pratica, significa conversazioni più corte e meno memoria durante l’interazione.

Una funzione interessante è la cosiddetta Thinking Mode, che espone il “ragionamento” intermedio del modello. Non si tratta di una novità assoluta, ma su un sistema offline assume un significato diverso: tutta l’elaborazione avviene sul dispositivo, senza invio di dati esterni.

Il punto è proprio questo: la percezione cambia. Scrivere una nota personale, una bozza disordinata o una domanda sensibile sapendo che i dati restano nel perimetro fisico dello smartphone produce una sensazione diversa rispetto al cloud. Non è solo una questione tecnica, ma anche psicologica. Va detto però che la sicurezza reale dipende comunque dal sistema operativo e dalle eventuali vulnerabilità locali.

Funzionalità offline, Agent Skills, riconoscimento vocale ed elaborazione immagini

AI Edge Gallery non si limita a replicare un chatbot: introduce un set di strumenti chiamato Agent Skills, che funzionano senza connessione. Il modello è integrato in micro-funzionalità utili: suggerimenti locali per ristoranti, generazione di QR code, strumenti di supporto alla navigazione.

In un’epoca in cui anche le operazioni più banali passano da API remote, avere strumenti completamente offline rappresenta un cambio significativo. Non tutto è perfetto, ma l’impostazione che in questo caso Google propone, seppur un po’ “sotto silenzio” vista la scarsa popolarità dell’app è certamente notevole.

Senza bisogno di cambiare modello AI, dalla schermata principale dell’app si può scegliere Ask Image oppure Audio Scribe.

Nel primo caso, il modello Gemma di Google può rispondere a domande sul contenuto di un numero massimo di 10 immagini inviate nell’ambito della stessa chat; nel secondo può effettuare elaborazioni su audio registrato con il microfono del dispositivo mobile o su file WAV. In entrambi i casi, basta toccare il pulsante “+” per allegare le risorse.

Per quanto riguarda l’audio, si può chiedere di tradurre o trascrivere il parlato: lo si può richiedere vocalmente oppure scrivere le proprie preferenze sotto forma di prompt testuale.

![]()

Prestazioni: limiti dell’hardware mobile

La differenza con il cloud ovviamente si percepisce: l’inferenza locale richiede tempo dal momento che CPU, GPU o NPU del dispositivo gestiscono il carico senza il supporto di infrastrutture distribuite. Su prompt semplici, la risposta arriva in tempi accettabili; su richieste più complesse, i tempi si ampliano (restando comunque più che accettabili anche con smartphone non propriamente premium).

Non è solo una questione di velocità: anche la qualità delle risposte può risultare meno raffinata rispetto a modelli più grandi eseguiti su sistemi remoti.

Un grosso limite è che al momento non sembra essere presente una vera cronologia delle conversazioni: non c’è alcuna memoria persistente. Quando si chiude la chat o se ne avvia una nuova, le precedenti interazioni sono perse per sempre (a meno di aggiornamenti migliorativi che potrebbero comunque arrivare in futuro).

L’unica cosa che l’app conserva (accessibile toccando “+” quindi Input history) è la cronologia dei prompt via via forniti dall’utente.

Quando ha senso usare AI locale

L’AI locale non sostituisce ancora il cloud, ma introduce scenari nuovi. L’uso offline ha senso in situazioni specifiche: viaggi senza connessione, necessità di riservatezza elevata, ambienti con policy restrittive sui dati. Si può pensare a un flusso ibrido: elaborazioni rapide e private sul dispositivo, attività più complesse delegate al cloud. È una convivenza che probabilmente vedremo sempre più spesso.

Nel complesso, AI Edge Gallery non è propriamente una “pietra miliare” ma segna comunque un passaggio importante: dimostra che l’inferenza locale non è più solo un esercizio tecnico. I limiti restano evidenti – prestazioni, memoria, capacità di contesto – ma il livello di maturità è sufficiente per un utilizzo reale, almeno in alcuni scenari.

/https://www.ilsoftware.it/app/uploads/2026/04/LLM-locale-smartphone-google-ai-edge-gallery.jpg)

/https://www.ilsoftware.it/app/uploads/2026/06/android-porte-rete.jpg)

/https://www.ilsoftware.it/app/uploads/2026/05/samsung-gallery-app-addio-onedrive.jpg)

/https://www.ilsoftware.it/app/uploads/2023/12/4-11.jpg)

/https://www.ilsoftware.it/app/uploads/2025/03/ILSOFTWARE-8.jpg)