Eseguire modelli linguistici avanzati in locale su hardware consumer non rappresenta più un esercizio teorico. L’evoluzione delle architetture ibride CPU-GPU-NPU e la disponibilità di framework ottimizzati hanno reso possibile portare carichi di lavoro che fino a poco tempo fa richiedevano infrastrutture cloud direttamente su workstation compatte. In questo contesto si inserisce l’approccio proposto da AMD per eseguire OpenClaw in locale su sistemi basati su Ryzen AI Max e GPU Radeon, una soluzione che sfrutta l’integrazione stretta tra memoria, acceleratori e stack software dedicati.

La spinta verso l’esecuzione locale non nasce solo da esigenze di performance, ma anche da vincoli legati a latenza, privacy e costi operativi, soprattutto considerando che modelli da decine o centinaia di miliardi di parametri richiedono quantità di memoria e throughput elevati.

OpenClaw in locale tra innovazione e rischio

L’esecuzione locale di agenti AI avanzati rappresenta una delle evoluzioni più significative nell’interazione uomo-macchina. OpenClaw è uno degli esempi più discussi: un sistema capace non solo di generare testo, ma di agire direttamente su un ambiente operativo, accedendo a file, servizi e applicazioni.

La crescente attenzione verso OpenClaw ha prodotto una frattura evidente: grandi organizzazioni e contesti enterprise ne limitano o vietano l’adozione. Perché, allora, AMD sembra promuoverne l’utilizzo parlando addirittura di progetti come RyzenClaw e RadeonClaw?

Il falso senso di sicurezza dell’esecuzione locale

Uno degli argomenti più ricorrenti a favore di OpenClaw è la possibilità di eseguirlo in locale. Tale configurazione è spesso interpretata come sinonimo di maggiore sicurezza e controllo. Tuttavia, l’analisi tecnica suggerisce una realtà molto più complessa.

L’esecuzione locale elimina la dipendenza dalle infrastrutture cloud, ma non riduce intrinsecamente la superficie di attacco. Al contrario, sposta il rischio direttamente sul dispositivo dell’utente. Un agente con accesso locale può:

- leggere e modificare file personali e riservati;

- interagire con credenziali salvate;

- eseguire comandi di sistema;

- comunicare con servizi esterni.

In assenza di un isolamento rigoroso, il perimetro di sicurezza coincide con l’intero sistema operativo! Il rischio non viene eliminato, ma internalizzato.

Prompt injection e supply chain: le nuove vulnerabilità sistemiche

La principale criticità degli agenti come OpenClaw risiede nella combinazione di autonomia e input non affidabili. Le tecniche di prompt injection, già note nel contesto dei modelli linguistici, possono avere conseguenze disastrose.

Un input manipolato può indurre l’agente di OpenClaw a condividere dati locali con soggetti terzi, eseguire script dannosi, interagire con endpoint compromessi.

A questo si aggiunge il problema della supply chain delle estensioni e delle “skill”. Moduli apparentemente innocui possono includere comportamenti nascosti, attivabili solo in condizioni specifiche. Il modello di estensibilità, se non accompagnato da rigorosi meccanismi di verifica, diventa un vettore di attacco potentissimo.

La strategia di AMD: l’AI locale come leva hardware

La posizione di AMD si colloca su un piano differente. L’interesse non è legato esclusivamente a OpenClaw, ma al paradigma che rappresenta: l’esecuzione locale di agenti AI complessi.

Le nuove architetture hardware, in particolare le piattaforme Ryzen AI e le GPU Radeon, sono progettate per supportare carichi di lavoro AI direttamente sul dispositivo. Promuovere applicazioni come OpenClaw significa dimostrare concretamente le capacità di queste soluzioni.

Questa strategia risponde a diverse esigenze:

- ridurre la dipendenza dal cloud;

- valorizzare le capacità di CPU, GPU e NPU;

- abilitare nuovi casi d’uso su PC e workstation.

OpenClaw funge da caso d’uso avanzato, capace di evidenziare il potenziale dell’AI locale in scenari reali. Questo non cancella però le criticità dell’agente AI, da molti considerato assolutamente inadatto a gestire dati personali reali, neppure con una configurazione attenta.

Architettura hardware: integrazione tra CPU, GPU e NPU

I sistemi basati su Ryzen AI Max+ utilizzano architettura Zen 5 abbinata a grafica integrata RDNA 3.5 e a una NPU XDNA 2 dedicata all’inferenza. Questa combinazione consente di distribuire il carico tra unità specializzate, evitando il collo di bottiglia tipico delle configurazioni CPU-only. Il modello di memoria unificata rappresenta uno degli elementi chiave: configurazioni fino a 128 GB di RAM permettono di caricare modelli di grandi dimensioni senza ricorrere a trasferimenti continui tra memoria di sistema e VRAM.

La GPU integrata o discreta Radeon interviene nei calcoli paralleli, mentre la NPU gestisce operazioni di inferenza a bassa latenza e consumo ridotto. Questo schema consente di mantenere un bilanciamento tra prestazioni e efficienza energetica, soprattutto nei carichi continui tipici degli agenti AI locali. L’approccio risulta particolarmente efficace con modelli Mixture of Experts, dove solo una frazione dei parametri viene attivata durante l’esecuzione, pur richiedendo comunque l’intero modello in memoria.

OpenClaw: runtime e gestione dei modelli locali

Dal punto di vista tecnico, OpenClaw si presenta come un framework open source progettato per orchestrare modelli linguistici e agenti AI su hardware locale. Il suo ruolo non si limita al caricamento del modello, ma include gestione delle dipendenze, interfacce API e integrazione con tool di inferenza come vLLM o llama.cpp.

Nel perimetro delle GPU AMD, OpenClaw utilizza direttamente le librerie compatibili con ROCm (Radeon Open Compute), una piattaforma che consente di sfruttare la potenza di calcolo della scheda grafica per eseguire operazioni in parallelo, migliorando così le prestazioni nei carichi di lavoro intensivi.

ROCm integra compilatori, runtime e librerie che permettono di eseguire codice in parallelo su GPU Radeon, con supporto a framework come PyTorch e ONNX Runtime. La versione 7.x introduce miglioramenti significativi nella gestione della memoria e nell’ottimizzazione del kernel, elementi fondamentali per l’inferenza di modelli di grandi dimensioni.

Su Windows, il supporto si è evoluto rapidamente grazie all’integrazione con driver Adrenalin e build portabili di tool come ComfyUI con ambienti di inferenza compatibili. L’esecuzione nativa elimina la necessità di configurazioni dual boot o workaround, rendendo l’accesso più immediato anche per ambienti di sviluppo non specialistici.

Cosa sono RyzenClaw e RadeonClaw

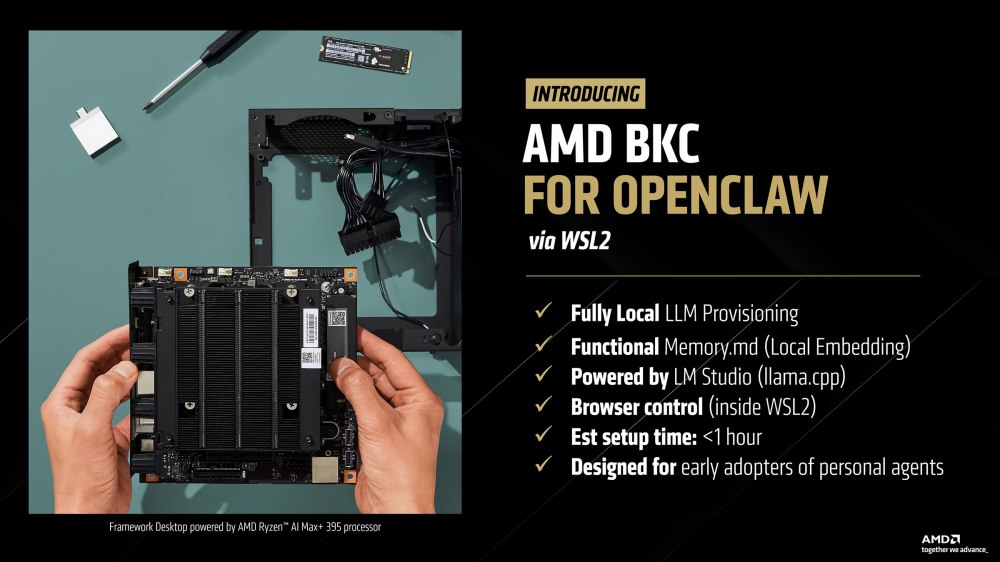

RyzenClaw e RadeonClaw non sono prodotti commerciali standalone, ma configurazioni di riferimento che combinano:

- hardware AMD specifico (CPU APU o GPU);

- stack software locale (LM Studio + llama.cpp + OpenClaw);

- ambiente di orchestrazione (WSL2 su Windows);

- modelli LLM ottimizzati (es. Qwen 3.5).

RyzenClaw è una configurazione basata su AMD Ryzen AI Max+ e memoria unificata fino a 128 GB. L’architettura consente a CPU, GPU integrata e NPU di condividere lo stesso spazio di memoria fisica. All’atto pratico, il LLM (Large Language Model) è caricato interamente nella RAM condivisa, riducendo l’overhead nella copia dei dati.

RadeonClaw, invece, è una configurazione basata su AMD Radeon AI PRO R9700 e VRAM dedicata ad alte prestazioni: qui il modello gira principalmente su GPU discreta con memoria separata. Le operazioni di inferenza sono accelerate tramite GPU con throughput molto più elevato, ma con vincoli più rigidi sulla memoria disponibile.

Lo stack software: dove avviene la magia

L’hardware da solo non basta. Il funzionamento di queste configurazioni messe a punto dai tecnici AMD dipende da uno stack software molto specifico, costruito attorno a tre elementi principali.

- LM Studio funge da runtime locale per i modelli linguistici. Utilizza backend come llama.cpp per eseguire inferenza ottimizzata su CPU e GPU, occupandosi di elementi fondamentali come la KV cache (una struttura di memoria che conserva coppie chiave-valore per accelerare il recupero delle informazioni nei modelli) e il batching dei token (il processo di raggruppamento di più unità di testo per ottimizzare l’elaborazione e migliorare le prestazioni). Espone inoltre un’API locale compatibile con formati tipo Anthropic, rendendo possibile l’integrazione con sistemi esterni.

- OpenClaw: non si limita a inviare prompt al modello, ma gestisce agenti multipli, sub-agenti, strumenti e memoria persistente. In pratica, è il layer che trasforma un LLM in un “sistema operativo per agenti“.

- Infine, l’ambiente WSL2 (Windows Subsystem for Linux 2) introduce un livello Linux all’interno di Windows, necessario per garantire compatibilità con toolchain, automazioni e componenti di sistema che OpenClaw utilizza per interagire con il mondo esterno, come browser automation e scripting.

La guida all’installazione e alla configurazione di OpenClaw su hardware Ryzen/Radeon mostra tutti i passaggi per sperimentare il comportamento dell’agente AI: alla fine si arriva a un sistema autonomo capace di operare (anche) sul Web.

Perché serve cautela (e non è un dettaglio)

Seguendo la guida stilata da AMD non si sta semplicemente installando un software, ma si sta costruendo un sistema capace di eseguire codice e comandi al posto dell’utente, anche in autonomia e in modo non presidiato; accedere a servizi esterni; navigare sul Web in autonomia; memorizzare informazioni persistenti; interagire con API e account.

In altre parole, si sta dando a un agente AI un livello di accesso molto vicino a quello di un utente reale.

Un errore di configurazione, un prompt male interpretato o un comportamento inatteso dell’agente AI possono portare a operazioni non desiderate: richieste automatiche, interazioni con siti, utilizzo improprio di API o gestione non corretta dei dati.

Inoltre, l’uso di memoria persistente ed embedding locali introduce un altro livello di rischio: i dati salvati possono essere riutilizzati in contesti non previsti, con possibili implicazioni sulla privacy o sulla coerenza delle decisioni.

Per questo motivo, AMD stessa inserisce un disclaimer: questi sistemi sono pensati per early adopters e ambienti controllati, non per un uso indiscriminato su macchine di produzione o con accesso a dati personali, riservati e sensibili.

/https://www.ilsoftware.it/app/uploads/2026/03/openclaw-AMD.jpg)

/https://www.ilsoftware.it/app/uploads/2024/07/grok.jpg)

/https://www.ilsoftware.it/app/uploads/2024/05/plugin-openvino-intelligenza-artificiale-generativa-GIMP.jpg)

/https://www.ilsoftware.it/app/uploads/2026/03/quale-modello-AI-eseguire-in-locale-hardware.jpg)

/https://www.ilsoftware.it/app/uploads/2024/03/matx-hardware-modelli-intelligenza-artificiale.jpg)